Des ondelettes à l’IA générative : les travaux de Stéphane Mallat, chercheur d’exception

Stéphane Mallat, professeur au Collège de France et membre du DI ENS1 , reçoit la médaille d’or du CNRS le 17 décembre 2025 à la Maison de la Chimie à Paris. Ses recherches pionnières ont marqué les mathématiques et les sciences informatiques tout en laissant une empreinte durable dans nombre d’autres disciplines scientifiques. Retour sur les résultats scientifiques de ces travaux fondateurs avec Jalal Fadili, professeur à l’ENSICAEN, directeur du centre AISSAI2 , et Gabriel Peyré, directeur de recherche CNRS au DMA3 .

Les recherches de Stéphane Mallat portent sur les mathématiques appliquées au traitement du signal et à l’intelligence artificielle. Acteur central de ces disciplines, il a établi avec la théorie des ondelettes un cadre qui a transformé des champs tels que la compression d’images, le traitement audio, la vision par ordinateur, la reconnaissance de formes et la modélisation des données. Ses travaux pionniers ont eu une influence considérable dans d’autres domaines scientifiques comme la biologie, la physique, la chimie quantique, l’astrophysique ou encore la finance. Ils ont aussi trouvé de nombreuses applications dans des domaines industriels comme la super-résolution vidéo et l’imagerie médicale.

Tous les résultats scientifiques de Stéphane Mallat sont précurseurs et laissent une empreinte significative et durable : ils donnent lieu à des articles de référence, cumulant des dizaines de milliers de citations. Ses contributions formalisent des concepts fondateurs, en rupture avec l’état de l’art, et ouvrent de nouveaux champs de recherche, rapidement explorés par une large communauté scientifique.

Cet article donne un aperçu des contributions les plus marquantes de l'œuvre scientifique de Stéphane Mallat.

Contexte

Comment analyser, synthétiser et représenter des fonctions quelconques à l’aide de briques de bases élémentaires ? Comment concentrer l’essentiel de l’information de la fonction dans un petit nombre de ces briques ? Comment associer à des techniques d’analyse harmonique1 des algorithmes rapides et performants essentiels pour les applications numériques ? Ce sont les questions fondamentales qui ont toujours constitué le fil conducteur des travaux de Stéphane Mallat. Elles résonnent avec la notion de représentation frugale qui est au cœur des enjeux modernes du traitement des données et de l’IA, montrant à quel point les travaux de Stéphane Mallat ont été précurseurs.

I. Ondelettes, géométrie et parcimonie

I.1 Les ondelettes

L’exemple le plus fondamental de briques élémentaires (aussi appelées « atomes ») est certainement celui de la transformée de Fourier, connue depuis le XIXe siècle. Les atomes sont les fonctions chacune étant une oscillation pure à la fréquence ![]() . Cette transformée peut être implémentée numériquement grâce au célèbre algorithme de la transformée de Fourrier rapide (FFT), que l’on doit à James Cooley et John Tuckey et dont la complexité est quasi-linéaire. S’il est connu que les approximations par des sommes partielles des séries de Fourier sont d’autant plus précises que la fonction à analyser est régulière, ces propriétés ne sont plus vraies dès qu’une singularité, même isolée, vient se glisser dans cette fonction ou si le signal contient différentes fréquences dominantes à différents intervalles de temps (comme dans un signal audio ou des notes de musique).

. Cette transformée peut être implémentée numériquement grâce au célèbre algorithme de la transformée de Fourrier rapide (FFT), que l’on doit à James Cooley et John Tuckey et dont la complexité est quasi-linéaire. S’il est connu que les approximations par des sommes partielles des séries de Fourier sont d’autant plus précises que la fonction à analyser est régulière, ces propriétés ne sont plus vraies dès qu’une singularité, même isolée, vient se glisser dans cette fonction ou si le signal contient différentes fréquences dominantes à différents intervalles de temps (comme dans un signal audio ou des notes de musique).

Ces constats conduisent à la conception d’outils d’analyse et de représentation plus puissants, tels que les ondelettes, apparues au début des années 1980 dans les travaux du géophysicien Jean Morlet et du physicien Alexandre Grossman. Une ondelette est une fonction bien localisée dans le plan temps-fréquence et oscillante (de moyenne nulle). Une famille de fonctions analysantes, dites ondelettes, est construite par translations et dilatations de l’ondelette de base, où le paramètre d’échelle ouvre la voie à l’analyse de phénomènes d’oscillation ou de singularités arbitrairement localisées en temps ou en espace.

Entre 1985 et 1992, Stéphane Mallat devient, aux côtés d’Yves Meyer et d’Ingrid Daubechies, l’un des fondateurs de la théorie des ondelettes. Ses travaux introduisent les bases orthogonales d’ondelettes et la théorie de l’analyse multi-résolution. En 1986, Stéphane Mallat et Yves Meyer proposent de systématiser l’approche suivie dans la construction du système de Haar pour obtenir des bases d’ondelettes ayant de meilleures propriétés avec l’idée de l’approximation multi-résolution. Cette avancée a profondément transformé des pans entiers des mathématiques, en particulier l’analyse harmonique, tout en influençant durablement le traitement et la modélisation des données (signaux, images, vidéos) et la vision par ordinateur.

- 1Branche des mathématiques qui étudie les relations entre une fonction et son contenu fréquentiel (au sens large).

L'article de Stéphane Mallat [Mallat89a] fait partie à ce jour des deux articles les plus cités du journal dans lequel il a été publié, le plus prestigieux en reconnaissance des formes et vision par ordinateur. Cet article et le suivant [Mallat89b] sont fondateurs de l’analyse multi-résolution, laquelle constitue un résultat fondamental de la théorie des ondelettes et de leur mise en œuvre efficace pour analyser des signaux, des images ou des vidéos. La construction de l'analyse multi-résolution conduit à un algorithme récursif rapide de calcul de la transformée en ondelettes, dont la complexité est linéaire. C’est l'équivalent en ondelettes de la FFT évoquée plus haut : c’est une révolution dans le domaine du traitement des données.

Les représentations en ondelettes possèdent des propriétés d’adaptativité locale qui se reflètent dans le seuillage des coefficients d’ondelettes et permettent une approximation optimale de fonctions irrégulières en une dimension par peu de coefficients. Au travers de la théorie de l’approximation non-linéaire, ces propriétés jouent un rôle crucial en compression, en débruitage ou pour la résolution de problèmes inverses en traitement des signaux et des images, ainsi qu’en simulation numérique adaptative des équations aux dérivées partielles. En particulier, ils ont débouché sur le standard de compression d’image JPEG-2000 et font désormais partie des classiques du traitement et de la modélisation des données enseignés à l'université, grâce à l’ouvrage Une exploration des signaux en ondelettes[Mallat99]. Ces résultats ont ouvert tout un pan de recherches couvrant de très nombreuses disciplines (sciences informatiques, mathématiques, biologie, physique, sciences de la terre et de l'univers, finance, etc.).

I.2 Les représentations multi-échelles géométriques

Si l’approximation en ondelettes est optimale pour les signaux monodimensionnels réguliers en dehors de singularités isolées, cette propriété n’est plus vraie en dimension supérieure. En effet, un seuillage dans une base d’ondelettes bidimensionnelles obtenues par simple produit tensoriel peut être vu comme une approximation par éléments finis de supports carrés, dont la taille est affinée au voisinage des singularités. Elles ne permettent pas de capturer la géométrie complexe des images le long de leurs contours car ces derniers sont des courbes régulières paramétrant les lieux de discontinuité de l’image. Pour améliorer la qualité de l’approximation, il est nécessaire d’adapter la géométrie des atomes à celle des contours dans l’image, par exemple en autorisant leur rotation et anisotropie.

À partir de 1993, pour capturer la régularité géométrique des scènes perçues par la vision humaine, Stéphane Mallat propose de nouvelles familles de constructions généralisant les ondelettes. Avec Erwan Le Pennec [Le Pennec05], il développe un frame adaptatif de bandelettes aboutissant à une représentation et une compression (quasi)optimale d’images géométriquement régulières – c’est-à-dire régulières en dehors de contours eux-mêmes réguliers (voir Figure 2). Cette construction est affinée avec Gabriel Peyré [Peyré08] pour obtenir des bases orthonormées de bandelettes jouissant des mêmes propriétés d’approximation optimale des images géométriquement régulières. Ces bases de bandelettes de seconde génération sont définies à partir d’une représentation en ondelettes en ajoutant une étape de transformation géométrique sur les coefficients en ondelettes eux-mêmes : une segmentation dyadique et un flot vectoriel indiquent la direction de la géométrie dans chaque carré de la segmentation.

La géométrie de flots localement parallèles des bandelettes manque de flexibilité pour modéliser des structures dans les images comme les jonctions. Pour dépasser ces limites, Stéphane Mallat n’hésite pas à adopter un point de vue radicalement novateur. Il s’inspire de concepts en neurosciences, comme la psychophysique de la « Gestalt », pour construire des bandelettes par groupements (appelés grouplets) [Mallat09] en définissant des groupements multi-échelles qui prennent en compte les jonctions et les régularités géométriques multi-échelles de longues portées.

Tous ces travaux sur les représentations géométriques parcimonieuses ont eu un retentissement considérable, tant en théorie de l’approximation et en mathématiques statistiques qu’en pratique, avec des applications allant jusqu’à l’échantillonnage compressé et l’imagerie médicale.

I.3 Les algorithmes de poursuite

L’article [Mallat93] est le deuxième article le plus cité de l'histoire de la revue la plus prestigieuse de traitement du signal. Stéphane Mallat y propose le matching pursuit, un algorithme de poursuite glouton qui est devenu le plus célèbre algorithme pour la décomposition en atomes de signaux admettant une représentation parcimonieuse dans un dictionnaire redondant (Figure 3). Il s'agit d'un travail fondateur pour tout le champ de la recherche autour des représentations parcimonieuses. Ces représentations sont notamment essentielles à la résolution de problèmes inverses en imagerie astronomique – pour l’analyse du rayonnement de fond cosmologique – ou biomédicale – pour le diagnostic à partir d’IRM ou d’images radiologiques –, par exemple.

II. Les mathématiques de l’IA

II.1 La théorie des réseaux de neurones profonds

Dans le prolongement de l’analyse harmonique et du traitement du signal, Stéphane Mallat développe une approche de l’intelligence artificielle où les réseaux de neurones sont pensés comme des représentations adaptées à la géométrie des données et aux symétries des phénomènes. Cela permet de mieux séparer, prédire et générer en grande dimension, pour des domaines comme l’astrophysique, la physique statistique, la chimie ou la finance. Face au succès des réseaux convolutifs profonds au début des années 2010 [Krizhevsky2012], il souligne la nécessité d’une théorie claire des invariances, de la stabilité et des représentations, afin de comprendre et guider ces modèles plutôt que de les traiter comme des boîtes noires.

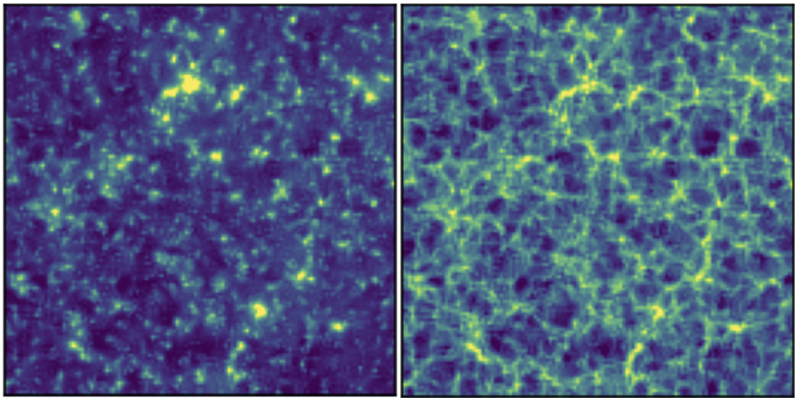

La scattering transform (Figure 4), introduite dans [Mallat12], répond à cet enjeu. Il s’agit de réseaux convolutifs où les couches cachées ne sont pas apprises : elles reproduisent une transformée en ondelettes multi-échelle (voir plus haut), enrichie de non-linéarités qui assurent l’invariance aux translations et la stabilité aux déformations. Ce cadre montre comment combiner filtrage multi-résolution, non-linéarités et agrégation pour obtenir les bonnes invariances sans perdre l’information fine nécessaire à la discrimination. Il fournit ainsi une base théorique rigoureuse aux réseaux convolutifs initialement introduits dans [LeCun1998] : leurs succès apparaissent comme la conséquence d’architectures qui épousent la géométrie des signaux [Brunat12, Mallat16].

Ses travaux plus récents, tels que [ZarkaGuthMallat2020], analysent de façon détaillée la manière dont ces réseaux réalisent la classification, en montrant comment, couche après couche, les moyennes de classes se séparent tandis que les fluctuations intra-classe

se contractent. Parallèlement, l’introduction d’architectures plus larges dont les couches sont apprises [GuthEtAl2024] permet de décrire, lorsque le nombre de neurones tend vers l’infini, des systèmes de features hiérarchiques associés à des espaces de Hilbert à noyau reproduisant adaptés aux données. Ces résultats éclairent la façon dont les réseaux organisent leurs représentations, dans la continuité de l’intuition fournie par les transformées de scattering.

II.2 L’IA générative et l’aléatoire en grande dimension

La révolution de l’IA générative, portée par les modèles de diffusion [Ho2020] et les grands modèles de langage (LLM) [Vaswani2017], ne consiste plus seulement à classer des données, mais à modéliser et synthétiser des distributions très complexes en grande dimension. Les travaux récents de Stéphane Mallat et ses collaborateurs et collaboratrices s’inscrivent dans ce contexte et proposent un cadre où modèles profonds, analyse harmonique et probabilités en grande dimension sont pensés ensemble.

Dans [GuthEtAl2023], ils montrent comment combattre le fléau de la dimension en structurant la génération de façon hiérarchique et multi-échelle : la distribution globale est décomposée en distributions conditionnelles sur des sous-espaces adaptés à différentes échelles. Cette organisation ouvre la voie à des algorithmes d’échantillonnage efficaces, dont le coût croît essentiellement comme la taille de la donnée à générer (par exemple, une image), et donne une interprétation claire du processus génératif où l’information se construit des grandes structures vers les détails selon une géométrie adaptée aux données.

Une question centrale est de savoir si ces modèles apprennent une structure sous-jacente ou se contentent de mémoriser. Dans [KadkhodaieEtAl2023], Stéphane Mallat et ses co-auteurs et co-autrices montrent que, au-delà d’une certaine taille de base, des modèles de diffusion entraînés sur des sous-ensembles disjoints convergent vers des champs de diffusion similaires. Ceci est le signe d’une densité continue plutôt que d’un catalogue d’images, et que les filtres appris forment des bases harmoniques adaptées à la géométrie des images naturelles. Ces résultats offrent des critères concrets pour distinguer modélisation et mémorisation. Ils soutiennent l’idée que ces méthodes génèrent de nouvelles données fiables plutôt que des copies déguisées.

III. L’IA pour les sciences : un échange continu entre modèles, données et théories

Une singularité du parcours de Stéphane Mallat est la façon dont ses avancées théoriques se construisent en dialogue étroit avec les autres sciences. Dans l’analyse de séries temporelles complexes (utilisées en turbulence, finance, acoustique), les wavelet scattering spectra [MorelEtAl2022] fournissent une représentation multi-échelle compacte qui capture l’intermittence, sauts rares et queues lourdes à partir d’une seule trajectoire, permet de générer des données synthétiques réalistes, d’affiner prévisions et stress-tests. La même idée sert à isoler des signaux sismiques martiens en régime de très faibles données [SiahkoohiEtAl2023].

En astrophysique et cosmologie, les méthodes fondées sur les covariances de coefficients de scattering [ChengEtAl2024] offrent des modèles probabilistes adaptés à des champs non gaussiens, filamenteux et peu échantillonnés, respectant rotations et changements d’échelle. Ces modèles sont capables de reproduire des statistiques d’ordre élevé et de générer des réalisations utiles à l’inférence et à la séparation de composantes. L’usage du scattering pour le milieu interstellaire [LevrierEtAl2021] permet de caractériser la géométrie complexe des structures et de concevoir des outils de débruitage compatibles avec les contraintes observationnelles.

En physico-chimie des matériaux, le solid harmonic wavelet scattering [EickenbergEtAl2018] fournit des descripteurs invariants, hiérarchiques et interprétables pour prédire des propriétés à partir de configurations atomiques complexes avec peu de données. La wavelet conditional renormalization group [MarchandEtAl2023], prolongée vers les systèmes hors équilibre [BrossolletEtAl2024], permet d’estimer des énergies effectives et de générer des configurations cohérentes aux grandes et petites échelles.

Ces contributions illustrent un même principe : des représentations multi-échelles structurées par l’analyse harmonique, le scattering et des idées de renormalisation, conçues pour épouser symétries et contraintes physiques, servent de base à des modèles probabilistes hiérarchiques qui unifient prédiction, génération et interprétation dans des domaines scientifiques variés.

Conclusion

Le parcours de Stéphane Mallat trace un fil conducteur entre ondelettes, parcimonie, traitement du signal, réseaux profonds et IA générative. En montrant comment bases multi-échelles et architectures structurées capturent la géométrie des données et les symétries des phénomènes, il a bâti un cadre unifié où analyse harmonique, géométrie, apprentissage statistique et modélisation numérique se nourrissent mutuellement pour aboutir à des visions très novatrices et éclairantes des questions en jeu.

Références

[Mallat89a] S. Mallat, A theory for multiresolution signal decomposition: the wavelet representation, IEEE Transactions on Pattern Analysis and Machine Intelligence, 11 (7), 674-693, 1989.

[Mallat89b] S. Mallat, Multiresolution approximations and wavelet orthonormal bases of 𝐿²(𝑅), Transactions of the American Mathematical Society, 315 (1), 69-87, 1989.

[Mallat92a] S Mallat and W. Hwang, Singularity detection and processing with wavelets, IEEE Transactions on Information Theory, 38 (2), 617-643, 1992.

[Mallat92b] S. Mallat and S. Zhong, Characterization of Signals From Multiscale Edges, IEEE Transactions on Pattern Analysis and Machine Intelligence, 14 (7), 710-732, 1992.

[Mallat93] S. Mallat and Z. Zhang, Matching pursuits with time-frequency dictionaries, IEEE Transactions on Signal Processing, 41 (12), 3397-3415, 1993.

[Mallat99] S. Mallat, A wavelet tour of signal processing, Elsevier, 1999.

[Le Pennec05] E. Le Pennec, S Mallat, Sparse geometric image representations with bandlets, IEEE Transactions on Image Processing 14 (4), 423-438, 2005.

[Peyré08] G. Peyré and S. Mallat, Orthogonal bandelet bases for geometric images approximation. Comm. Pure Appl. Math., 61: 1173-1212, 2008.

[Mallat09] S. Mallat, Geometrical grouplets, Applied and Computational Harmonic Analysis,

26:2 161-180, 2009.

[Mallat12] S. Mallat, Group invariant scattering, Communications on Pure and Applied Mathematics 65 (10), 1331-1398, 2012.

[Brunat12] J. Bruna, S. Mallat, Invariant scattering convolution networks, IEEE Transactions on Pattern Analysis and Machine Intelligence 35 (8), 1872-1886, 2013.

[Mallat16] S. Mallat, Understanding deep convolutional networks, Philosophical Transactions of the Royal Society A: Mathematical, Physical and Engineering Sciences, 374 (2065), 2016.

[Krizhevsky2012] A. Krizhevsky, I. Sutskever, G. E. Hinton, ImageNet Classification with Deep Convolutional Neural Networks, Advances in Neural Information Processing Systems (NeurIPS), 2012.

[LeCun1998] Y. LeCun, L. Bottou, Y. Bengio, P. Haffner, Gradient-Based Learning Applied to Document Recognition, Proceedings of the IEEE, 86(11):2278-2324, 1998.

[Ho2020] J. Ho, A. Jain, P. Abbeel, Denoising Diffusion Probabilistic Models, Advances in Neural Information Processing Systems (NeurIPS), 2020.

[Vaswani2017] A. Vaswani et al., Attention Is All You Need, Advances in Neural Information Processing Systems (NeurIPS), 2017

[Mallat2012] S. Mallat, Group Invariant Scattering, Communications on Pure and Applied Mathematics, 2012.

[ZarkaGuthMallat2020] J. Zarka, F. Guth, S. Mallat, Separation and Concentration in Deep Networks, 2020.

[GuthEtAl2024] F. Guth, B. Ménard, G. Rochette, S. Mallat, A Rainbow in Deep Network Black Boxes, Journal of Machine Learning Research, 2024.

[KadkhodaieEtAl2023] Z. Kadkhodaie, F. Guth, E. P. Simoncelli, S. Mallat, Generalization in Diffusion Models Arises from Geometry-Adaptive Harmonic Representations, 2023.

[GuthEtAl2023] F. Guth, E. Lempereur, J. Bruna, S. Mallat, Conditionally Strongly Log-Concave Generative Models, ICML, 2023.

[MorelEtAl2022] R. Morel, G. Rochette, R. Leonarduzzi, J.-P. Bouchaud, S. Mallat, Scale Dependencies and Self-Similar Models with Wavelet Scattering Spectra, 2022.

[SiahkoohiEtAl2023] A. Siahkoohi et al., Unearthing InSights Into Mars: Unsupervised Source Separation with Limited Data, 2023.

[ChengEtAl2024] S. Cheng, R. Morel, E. Allys, B. Ménard, S. Mallat, Scattering Spectra Models for Physics, PNAS Nexus, 2024.

[LevrierEtAl2021] F. Levrier, E. Allys, B. Régaldo-Saint Blancard, F. Boulanger, N. Jeffrey, Scattering Transforms for Interstellar Astrophysics and Beyond, 2021.

[EickenbergEtAl2018] M. Eickenberg, G. Exarchakis, M. Hirn, S. Mallat, L. Thiry, Solid Harmonic Wavelet Scattering for Predictions of Molecule Properties, Journal of Chemical Physics, 2018.

[BrossolletEtAl2024] A. Brossollet, E. Lempereur, S. Mallat, G. Biroli, Effective Energy, Interactions and Out of Equilibrium Nature of Scalar Active Matter, 2024.

[MarchandEtAl2023] T. Marchand, M. Ozawa, S. Mallat, Multiscale Data-Driven Energy Estimation and Generation, Physical Review X, 2023.